Microsoft mantiene equipo ‘red team’ para hackear sus propios productos de IA y definir límites éticos

Por Redacción

Redmond, 20 de marzo de 2026.- Microsoft confirmó que mantiene activo un equipo multidisciplinario conocido como ‘red team’ o equipo rojo, dedicado a hackear sus propios productos de inteligencia artificial para identificar vulnerabilidades y establecer límites de uso. Esta práctica, que la compañía asegura haber pionerizado desde 2021, busca garantizar que el desarrollo tecnológico se mantenga dentro de principios éticos definidos y publicados por la corporación.

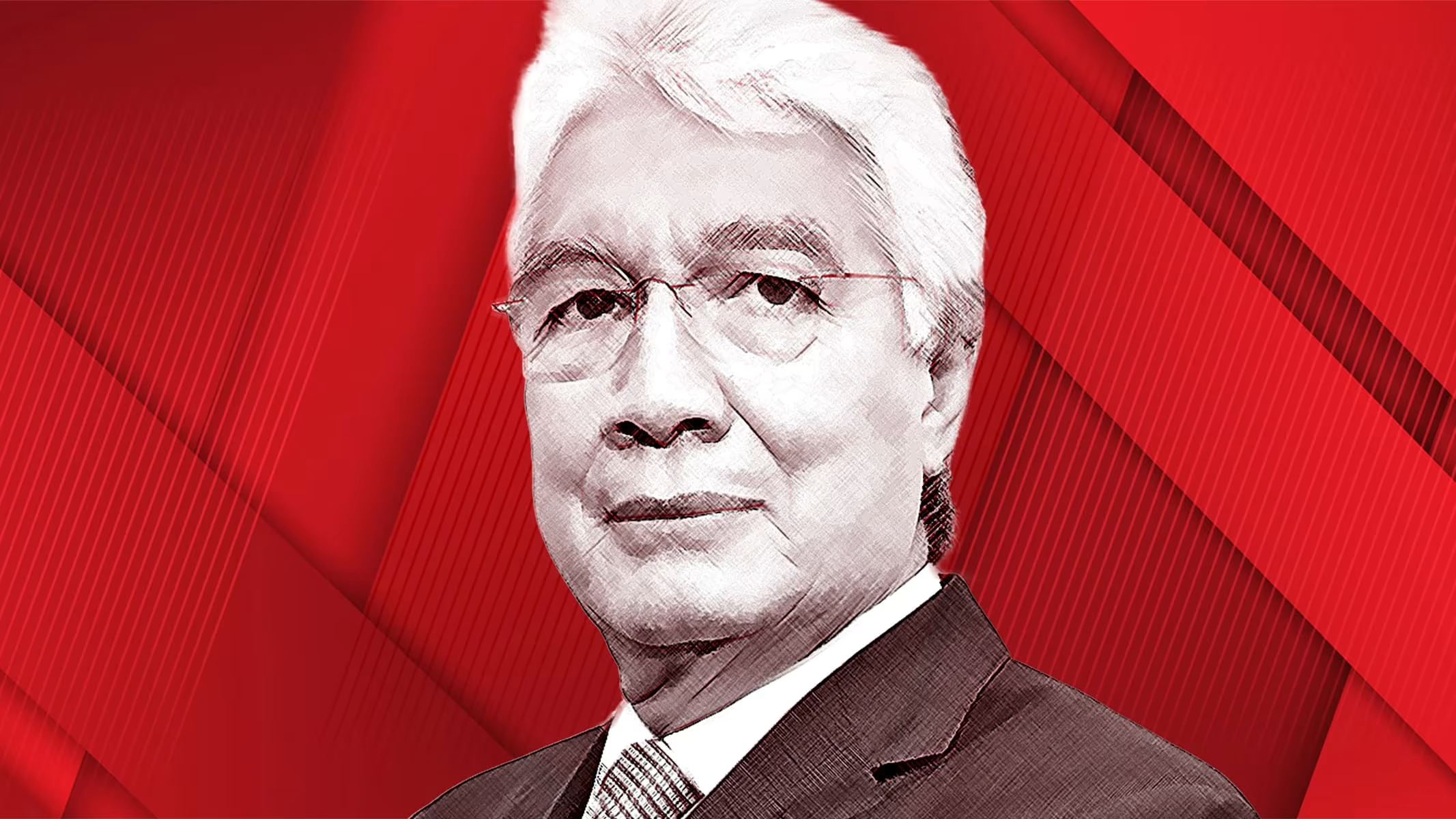

Brad Smith, presidente de Microsoft, explicó que la existencia de estos principios crea guardarraíles obligatorios para el desarrollo de la empresa. “Tenemos principios, los definimos y los publicamos. Por definición, esos principios crear guardarraíles. Y nos mantenemos en la carretera dentro de ellos”, declaró Smith. El ejecutivo enfatizó que la estrategia no solo determina cuándo utilizar la tecnología, sino también cuándo es necesario abstenerse de hacerlo.

El reporte indica que este equipo de seguridad opera bajo una metodología de pruebas ofensivas, intentando romper o evadir las protecciones de sus propios sistemas para fortalecerlos antes de su lanzamiento al mercado. Aunque la investigación no detalla la composición exacta del grupo ni los métodos específicos de hacking empleados, se establece que se trata de una fuerza de trabajo diversa diseñada para desafiar los productos desde múltiples perspectivas.

La implementación del ‘red teaming’ en Microsoft tiene sus raíces en prácticas militares y de ciberseguridad utilizadas desde hace décadas. El contexto actual de esta estrategia se da en medio de un debate global sobre el uso de la inteligencia artificial en aplicaciones bélicas, un tema que ha generado tensiones en la industria tecnológica, incluyendo demandas de empresas como Anthropic contra el Pentágono y la cancelación de acuerdos previos entre Microsoft y el departamento de defensa estadounidense en 2021.

Con la reafirmación de este equipo interno, Microsoft busca posicionar su enfoque de seguridad proactiva como un estándar en la industria, diferenciándose mediante la publicación transparente de sus principios operativos. La compañía sostiene que mantenerse dentro de estos límites es fundamental para navegar los riesgos asociados con el avance rápido de la inteligencia artificial.